Offset explorer как пользоваться

Offset Explorer is an open source tool for monitoring and managing consumer group offsets in an Apache Kafka cluster. It provides a simple and intuitive user interface for viewing and managing the details of Kafka consumer group offsets.

Offset Explorer has the following main functions and features:

Real-time monitoring: Offset Explorer can monitor the consumer group offset in the Kafka cluster in real time. It is able to track the consumer group from the earliest offset to the latest offset and show the progress of the consumer group consuming messages.

Offset Management: Offset Explorer allows users to view and modify offsets of consumer groups. Users can manually reset the consumer group’s offsets, if needed to re-consume some messages, or roll back the offsets to their previous state.

Topic and partition information: Offset Explorer provides detailed information about topics and partitions in the Kafka cluster. Users can view the offset of each partition, the first offset, the latest offset, etc.

Utilities: Offset Explorer provides some utilities to help users monitor and manage Kafka clusters. For example, users can export offset information as a CSV file, or search for specific consumer groups and topics.

User-Friendly Interface: Offset Explorer’s user interface is designed to be simple and intuitive, making it easy to use. Users can access the Web interface of Offset Explorer through a browser, and view and manage offsets through simple operations.

Overall, Offset Explorer is a powerful and easy-to-use Kafka monitoring tool that helps users monitor consumer group offsets in real time and provides convenient management functions. By using Offset Explorer, users can better understand and manage the consumption progress of Kafka consumer groups, ensuring reliable data processing and stable operation of consumers.

2. Use of Offset Explorer

(1) Install Offset Explorer

(2) Configure local Kafka

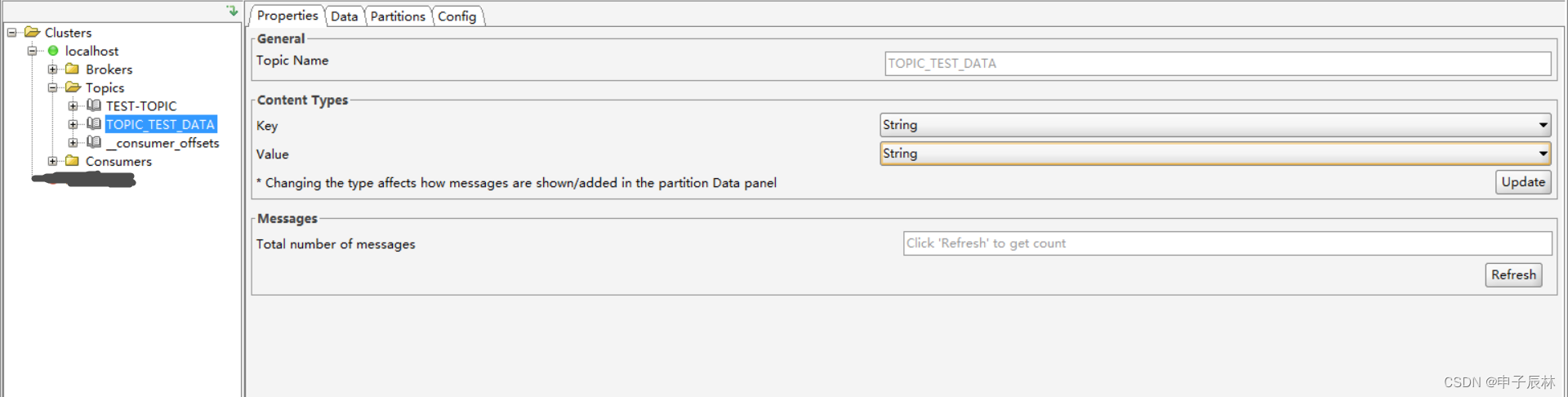

(3) Configure the specified Topic Configure

to use String to view data

(4) Get data

(5) Set to JSON format

Kafka Offset Explorer 2.3.1

There are multiple ways to connect to kafka topic. One way to do it is using SSL connection. This is How to do:

Requirements:

Kafka Truststore (.jks) and password & private password, Kafka KeyStore (.jks) and password

Kafka Offset Explorer/

Bootstrap servers (comma separated)

Open Offset Explorer and in security tab, enter Trtuststore and Keystoredetails.

Then on Advanced tab, enter the Bootsrap servers separated by commas

Then click on test connection to verify the trust and key store files and passwords.

When the connection is through, it will ask to add, the below details will be added to your offset explorer.

With Avatar promise �� on coming up with more How to-do’s — signing off for now.

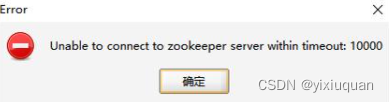

software configuration

1. Start offsetexplorer.exe, and fill in the Cluster name and other parameter information under the Properties option in the Add Cluster window If the zookeeper service is not set up, no need to modify the configuration parameters of zookeeper, even if the pop-up box on the following page reports an error prompt Unable to connection zookeeper server, it will not affect

If the zookeeper service is not set up, no need to modify the configuration parameters of zookeeper, even if the pop-up box on the following page reports an error prompt Unable to connection zookeeper server, it will not affect

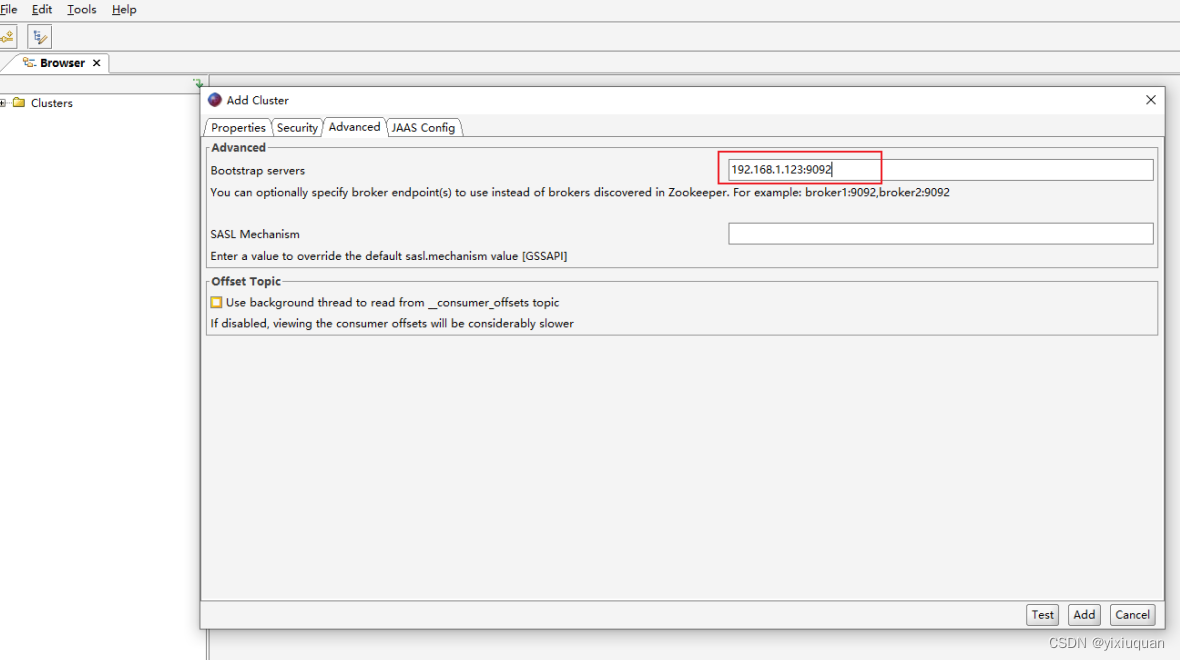

If the Zookeeper service is not configured, you need to configure the IP port of the Kafka service.

Under the Advanced option in the Add Cluster window, fill in the Bootstrap servers parameter, the ip and port for kafka service After configuration, you can click the Test button to test whether it can connect normally.

After configuration, you can click the Test button to test whether it can connect normally.

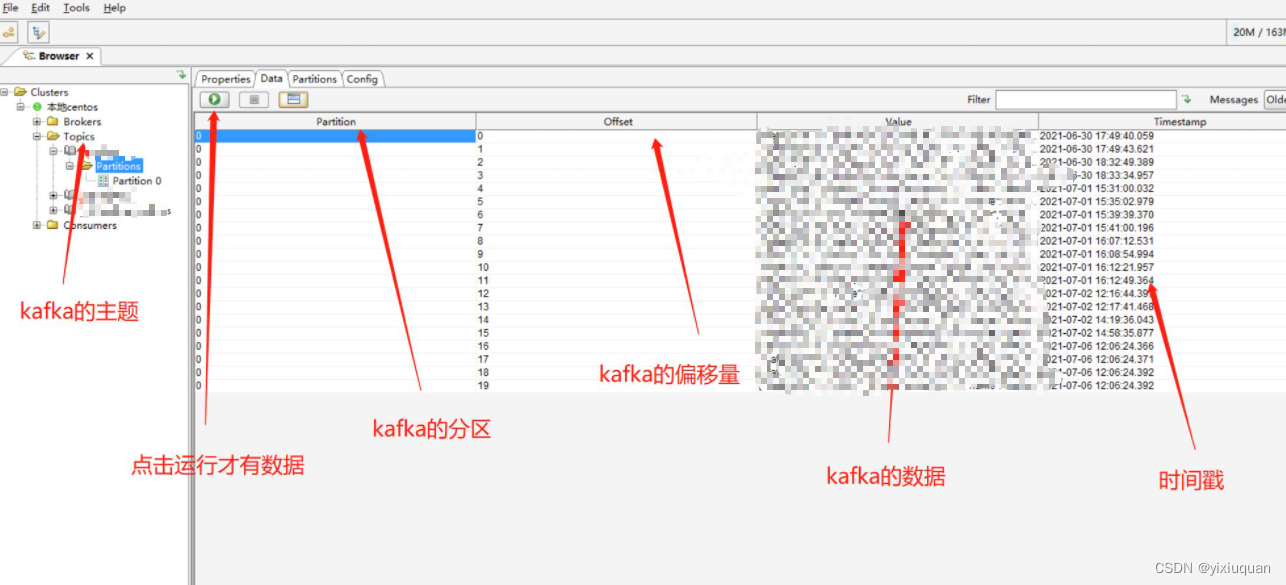

2. After kafka is successfully connected, you can see the Topics information of the kafka, etc. If it is a cluster kafka, you can see the information of all nodes under the cluster.

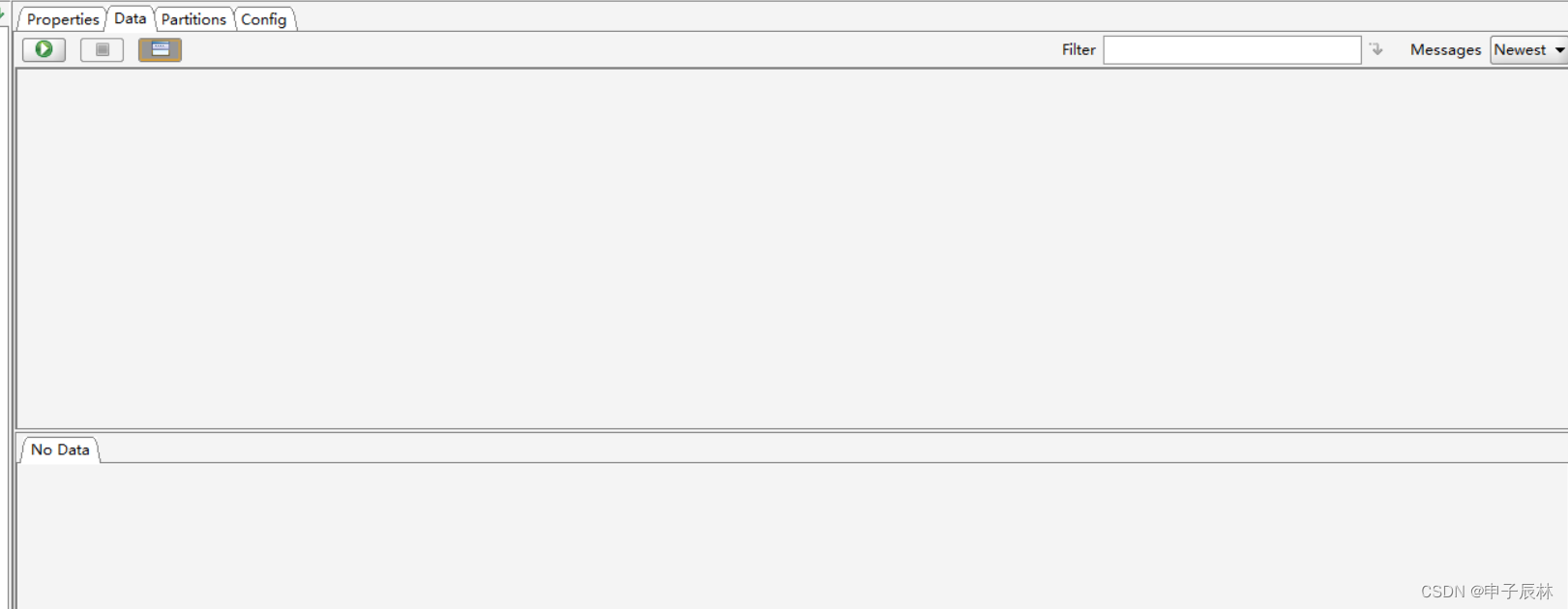

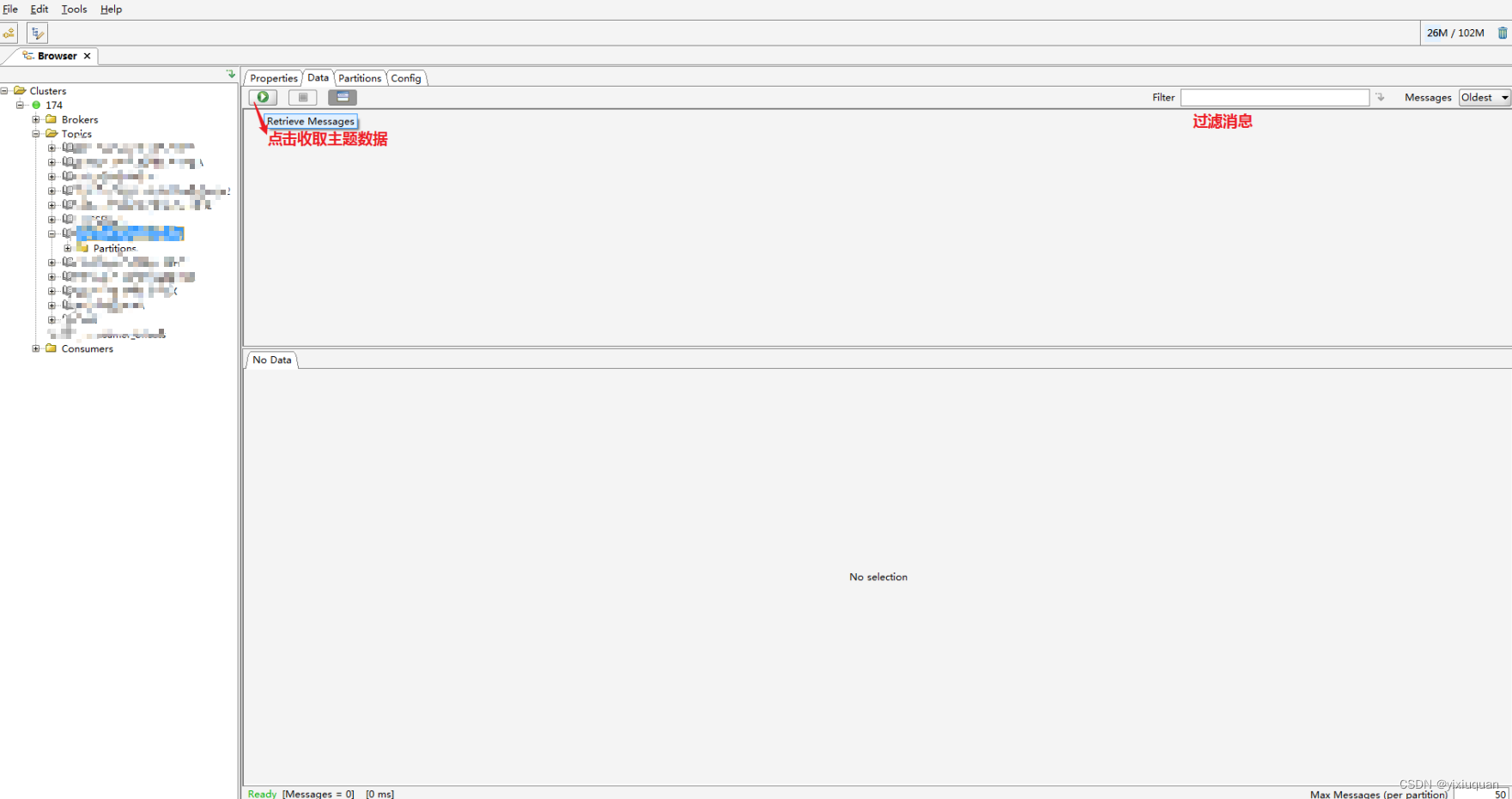

Open a topic, click Data to view the data, and click the green play button to display the data

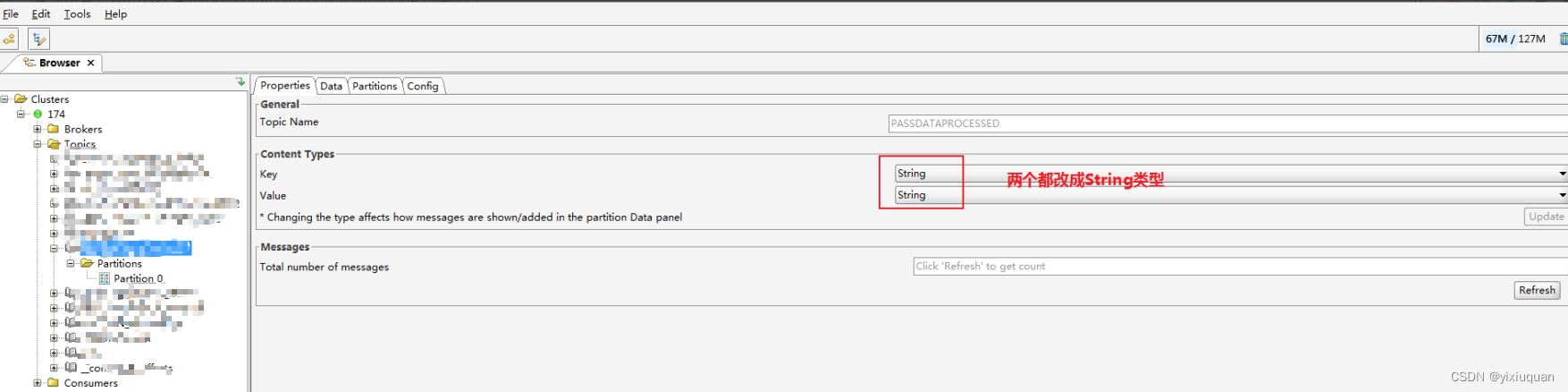

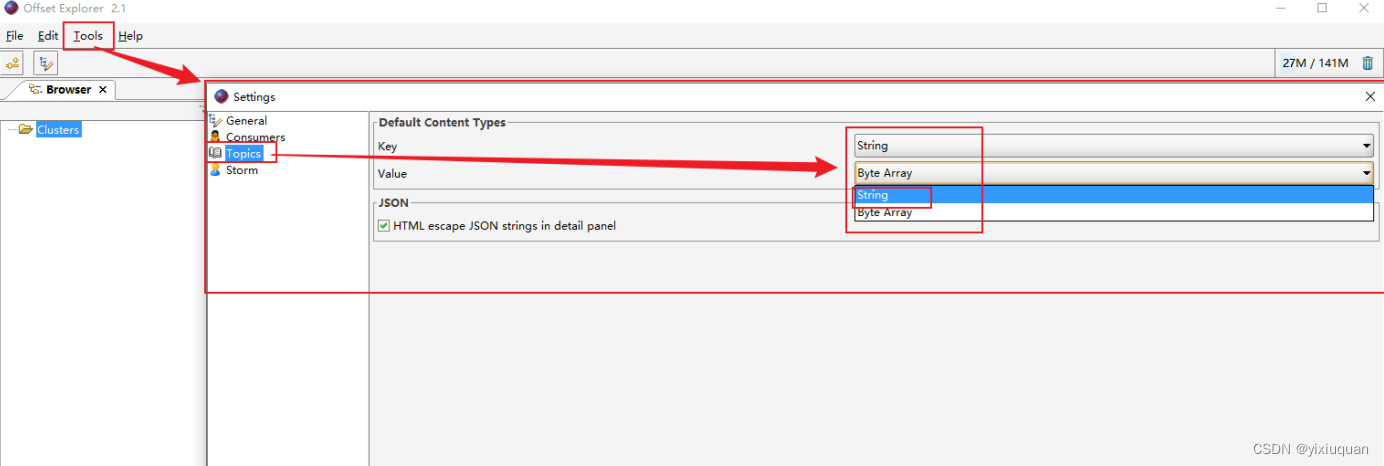

Seeing that the displayed data is all byte type, you need to convert it to a character type to view, modify the Content Types, the default is Byte Array, modify them to String, and then update

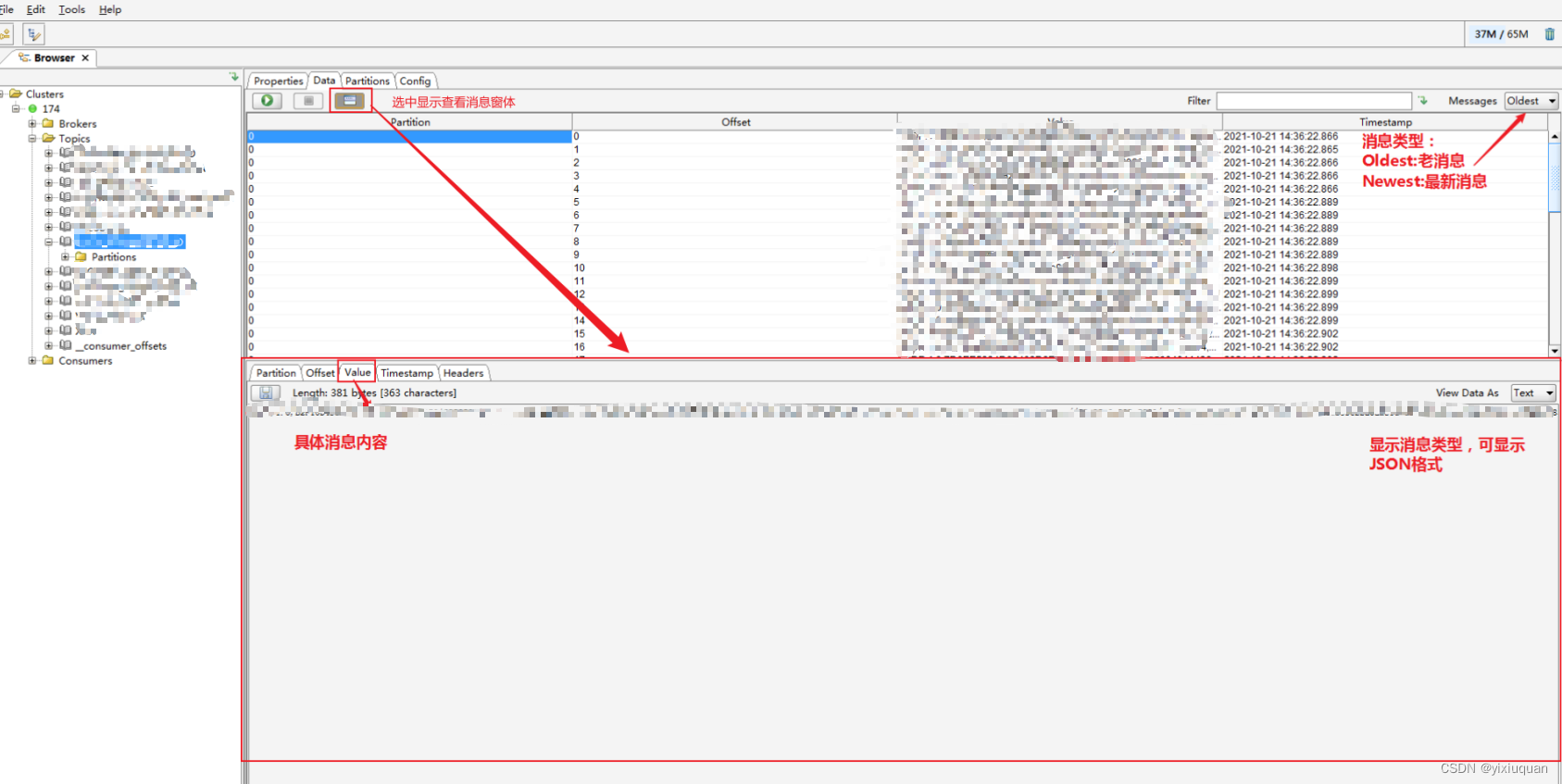

After selecting the topic, enter the Data tab page, view the message, filter the message through Filter, and set the type of received message in Message. To view the specific message, you need to open the message display form first, select the message and enter the Value tab below to view the specific message, if it is JSON data, you can display the type through the message type on the right

After selecting the topic, enter the Data tab page, view the message, filter the message through Filter, and set the type of received message in Message. To view the specific message, you need to open the message display form first, select the message and enter the Value tab below to view the specific message, if it is JSON data, you can display the type through the message type on the right

Note that if you only modify the Content Types on a certain topic, only the current topic encoding method will take effect, and the other topic encoding methods will remain unchanged. If you need to modify all topics to take effect, you can set Default in Tools->Settings->Topics Content Types. Both Key and Value are set to String.

Note that if you only modify the Content Types on a certain topic, only the current topic encoding method will take effect, and the other topic encoding methods will remain unchanged. If you need to modify all topics to take effect, you can set Default in Tools->Settings->Topics Content Types. Both Key and Value are set to String. create topic

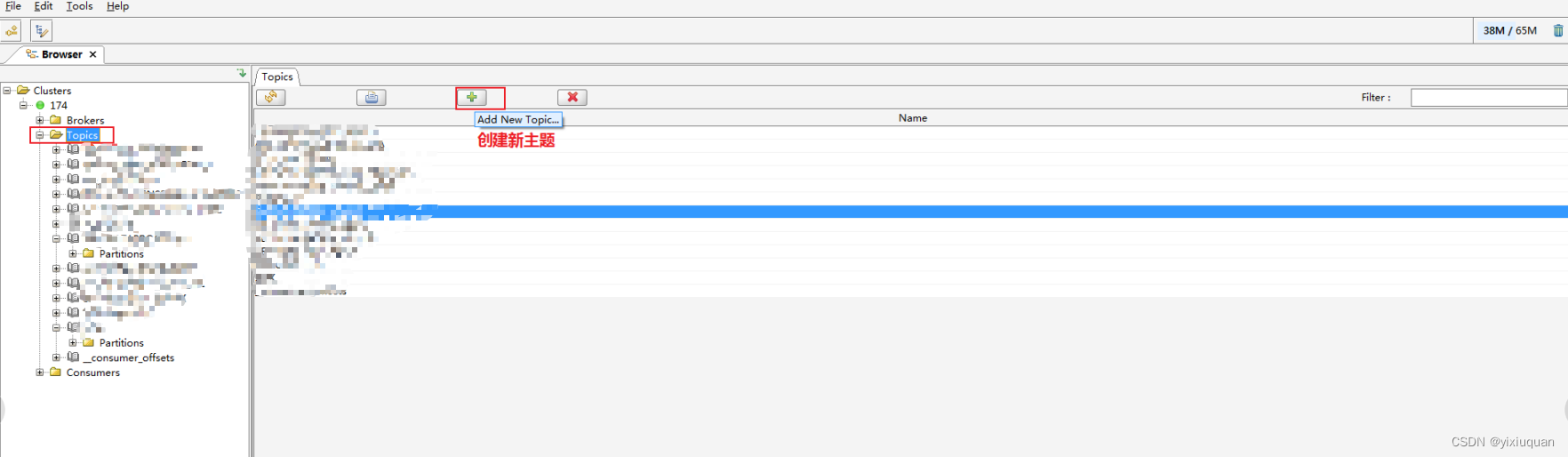

create topic

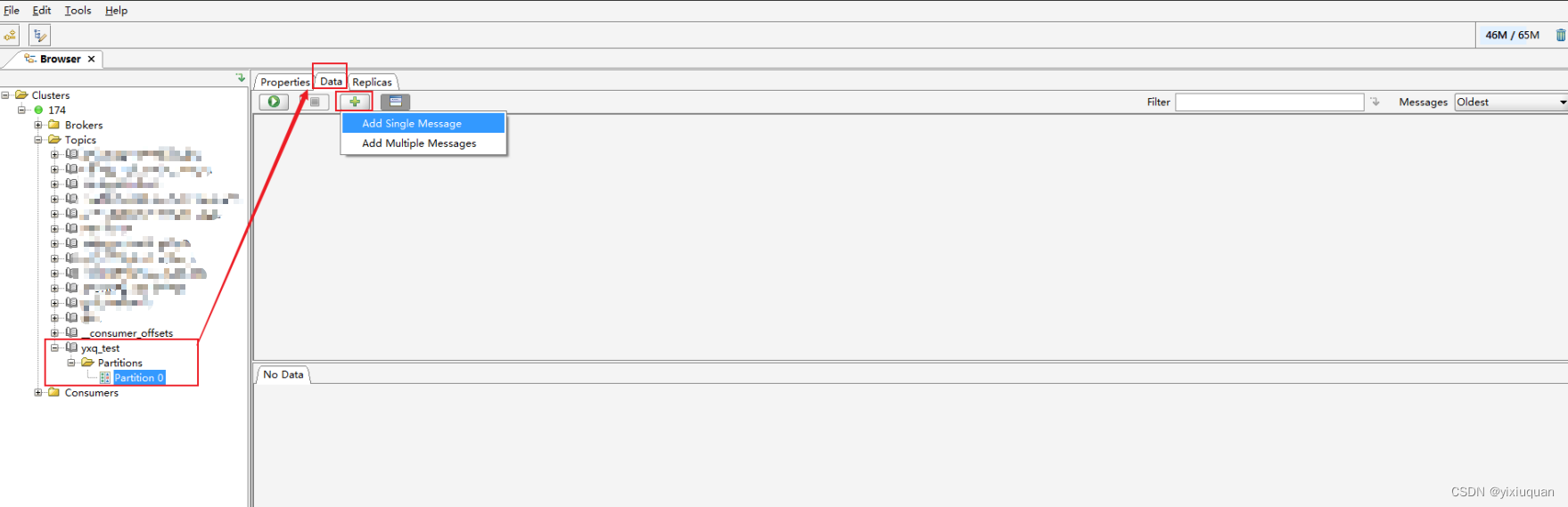

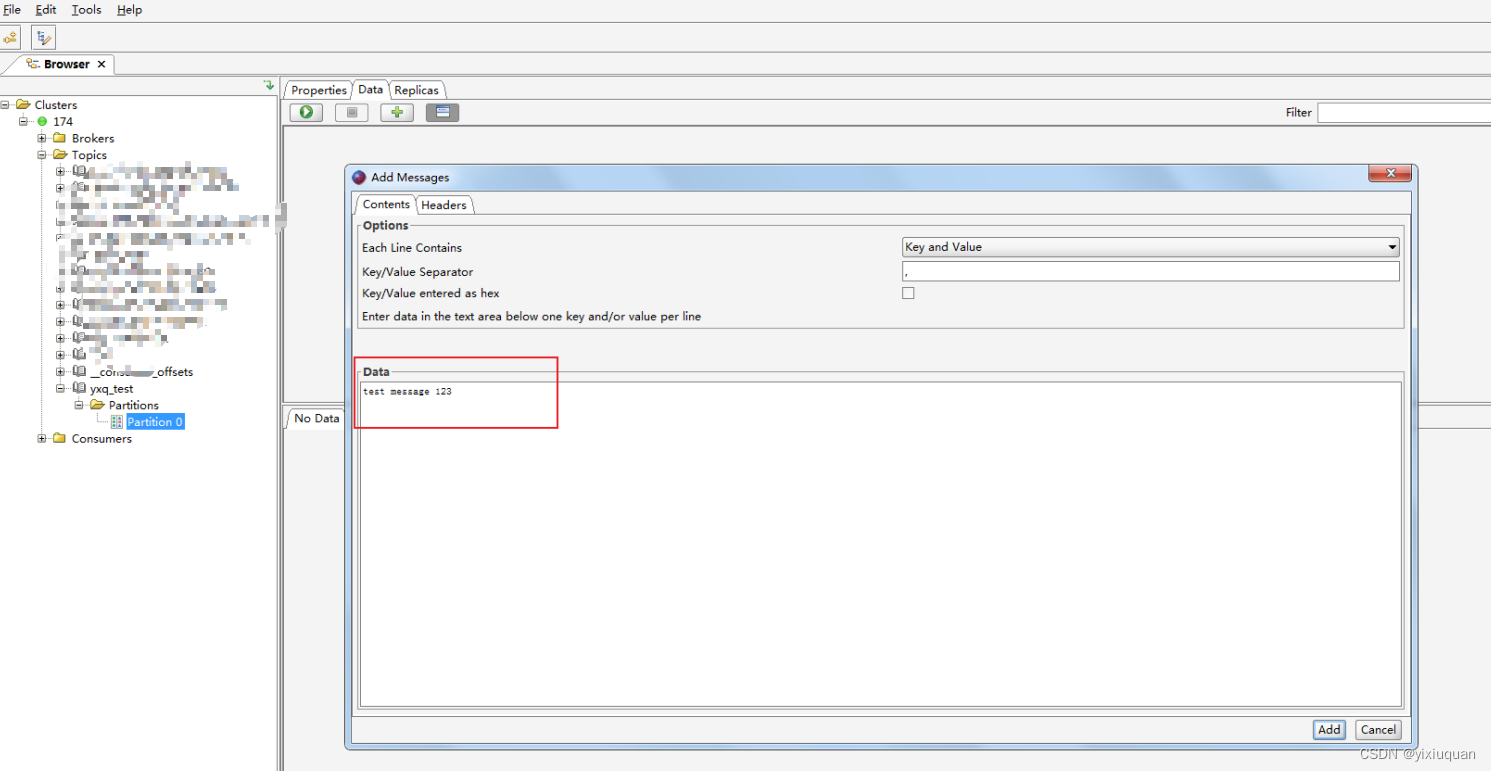

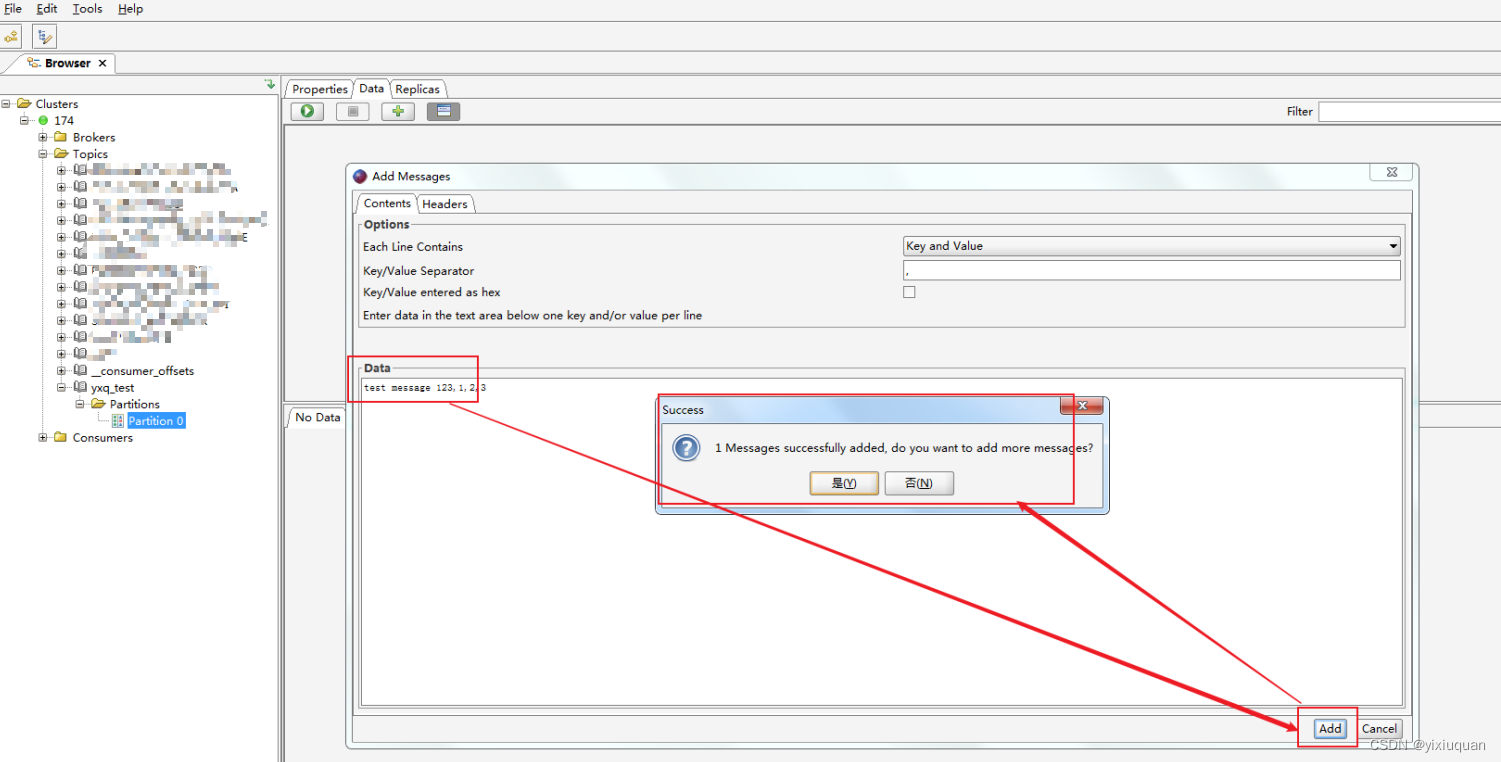

send topic message

Использование Offset Explorer

Offset Explorer (ранее Kafka Tool) — это приложение с графическим интерфейсом для управления и использования кластеров Apache Kafka. Он предоставляет интуитивно понятный пользовательский интерфейс, который позволяет быстро просматривать объекты в кластере Kafka,

а также сообщения, хранящиеся в темах кластера. Он содержит функции, ориентированные как на разработчиков, так и на администраторов. Вот некоторые из ключевых особенностей:【 Больше никаких материалов на китайском языке, размещенных непосредственно на английском языке 】

Offset Explorer бесплатен только для личного использования. Любое неличное использование, включая коммерческое, образовательное и некоммерческое использование, без приобретения лицензии не допускается. Неличное использование разрешено в ознакомительных целях в течение 30 дней после загрузки Offset Explorer, после чего вы должны приобрести действующую лицензию или удалить программное обеспечение.

Offset Explorer (front Kafka Tool) — это инструмент для управления и использования кластерных приложений с графическим интерфейсом Apache Kafka. Он предоставляет интуитивно понятный пользовательский интерфейс. Вы можете быстро просматривать объекты Kafka в кластере и сообщения, хранящиеся в темах кластера. Он содержит функции для разработчиков и администраторов. Основные функции включают:

- Быстрый просмотр всей колонии Кафки, включая их агентов, темы и потребителей;

- Просмотреть содержимое сообщения в разделе и добавить новое сообщение;

- Просмотреть смещение потребителя , включить потребителя носика Apache Storm Kafka ;

- Улучшить отображение новостей JSON, XML и Avro ;

- Добавлять и удалять темы и другие административные функции;

- Сохраняйте каждое сообщение из раздела на локальный жесткий диск;

- Создание собственных подключаемых модулей, позволяет просматривать пользовательские форматы данных;

- Offset Explorer поддерживает операционные системы Windows, Linux и Mac.

Offset Explorer бесплатен для личного использования. Любое не физическое лицо, в том числе бизнес, образование и некоммерческая деятельность не могут использоваться без лицензии. В скачанном Offset Explorer через 30 дней. , Разрешить не физическим лицам использовать программное обеспечение для оценки , После этого вы должны приобрести действующую лицензию или удалить программное обеспечение .

2. Установка и простота использования

Windows При установке версии не на что обращать внимание ,Linux Версия не может быть загружена с официального сайта Оставьте здесь структуру каталогов , Скачал до дополнения .

Установлена версия Linux 2.1

2.2 Простота установки

Введите в первый раз:

Тема запроса данных Будьте осторожны :Сообщения Вы можете выбрать самые старые или самые новые :

3. Ключевые особенности

Протестируйте одну функцию за другой:

3.1 Быстрый просмотр всей колонии Kafka, включая их агентов, темы и потребителей;

3.2 Просмотр содержимого сообщения в разделе и добавление нового сообщения ;

Добавить несколько новых сообщений:

3.3 Просмотр смещения потребителя, включение потребителя носика Apache Storm Kafka ;

3.4 Украсьте отображение новостей JSON, XML и Avro;

3.5 Добавление и удаление тем и других административных функций;

3.6 Сохраняйте каждое сообщение из раздела на локальный жесткий диск;

3.7. Создание собственных подключаемых модулей. Позволяет просматривать пользовательские форматы данных.

Это еще не изучено .

3.8 Offset Explorer поддерживает операционные системы Windows, Linux и Mac.

Текущая демонстрация — версия для Windows, Linux. Версия не была успешно загружена, нет, Mac, поэтому компьютерную систему нельзя протестировать.

Вы также можете просто скачать пакеты и отправить их в репозиторий

Шаг 5. Скопируйте сценарий

Добавьте это в сценарий PowerShell или используйте пакетный сценарий с инструментами и в тех местах, где вы звоните непосредственно в Chocolatey. При интеграции учитывайте расширенные коды выхода.

Если вы используете сценарий PowerShell, используйте следующие действия, чтобы неверные коды выхода отображались как сбои:

В вашем Script Builder уже есть версия этого пакета

Загрузки версии 2.2:

04 октября 2021 г.

Автор(ы) программного обеспечения:

Проводник смещения (ранее инструмент Kafka)

2.2 | Обновлено: 4 октября 2021 г.

Редактировать пакет

Чтобы изменить метаданные пакета, загрузите обновленную версию пакета.

Репозиторий пакетов сообщества Chocolatey в настоящее время не позволяет обновлять метаданные пакета на веб-сайте. Это помогает гарантировать, что сам пакет (и исходный код, используемый для сборки пакета) остается единственным истинным источником метаданных пакета.

Для этого требуется увеличить версию пакета.

Все проверки пройдены

3 прохождения тестов

Проверка сканирования прошла успешно:

Ни в одном из файлов пакета обнаружений не обнаружено

Метод развертывания: индивидуальная установка, обновление и удаление

Чтобы установить Offset Explorer (ранее Kafka Tool), выполните следующую команду из командной строки или из PowerShell:

Чтобы обновить Offset Explorer (ранее Kafka Tool), выполните следующую команду из командной строки или из PowerShell:

Чтобы удалить Offset Explorer (ранее Kafka Tool), выполните следующую команду из командной строки или из PowerShell:

Метод развертывания:

�� ПРИМЕЧАНИЕ. Это относится как к открытым, так и к коммерческим версиям Chocolatey.

1. Введите URL вашего внутреннего репозитория

2. Настройте свою среду

1. Убедитесь, что вы настроены на организационное развертывание

2. Загрузите пакет в свою среду

3. Скопируйте свой сценарий

Добавьте это в сценарий PowerShell или используйте пакетный сценарий с инструментами и в тех местах, где вы звоните непосредственно в Chocolatey. При интеграции учитывайте расширенные коды выхода.

Если вы используете сценарий PowerShell, используйте следующие действия, чтобы неверные коды выхода отображались как сбои:

4. Если применимо — конфигурация/установка Chocolatey

См. матрицу управления инфраструктурой для элементов конфигурации и примеров Chocolatey.

Загрузки из кэша частной CDN доступны для лицензированных клиентов. Никогда больше не сталкивайтесь с поломкой 404! Узнать больше.

Этот пакет был одобрен модератором jpruskin 12 октября 2021 г.

Браузер Kafka

Дерево браузера в Offset Explorer позволяет просматривать и перемещаться по объектам в кластере Apache Kafka® — брокерам, темам, разделам, потребителям — с помощью нескольких щелчков мыши. Подключения к вашему кластеру Kafka сохраняются, поэтому вам не нужно запоминать или вводить их каждый раз. Вы можете быстро просмотреть информацию обо всех ваших кластерах, сколько бы их у вас ни было.

Просмотреть сообщения

Вы можете быстро просмотреть сообщения и их ключи в разделах ваших тем. Вы можете выбрать, сколько сообщений просматривать одновременно и с какого смещения читать сообщения. Вы можете просмотреть самые старые или самые новые сообщения или указать начальное смещение, с которого начинать чтение сообщений. По умолчанию Offset Explorer покажет ваши сообщения и ключи в шестнадцатеричном формате. Однако, если ваши сообщения представляют собой строки в кодировке UTF-8, Kafka Tool может отображать реальную строку вместо обычного шестнадцатеричного формата.

Просмотр текстовых данных в формате JSON/XML

Если ваши строковые данные представлены в формате JSON или XML, вы можете просмотреть их в красивой печатной форме на панели сведений на вкладке «Данные» в разделах.

Просмотр компенсаций потребителей

Дерево браузера позволяет быстро просмотреть все смещения ваших потребителей Kafka. В списке будут показаны как начальные/конечные смещения разделов, так и смещения потребителей в каждом разделе.

Вы также можете просмотреть смещения, сохраненные носиками Kafka Apache Storm. Подробнее

Сохранение отдельных сообщений

Вы можете сохранить отдельные сообщения в файл на жестком диске, используя кнопку «Сохранить» на панели сведений вкладки «Данные» разделов. Файл будет содержать байты сообщения как есть. Вы также можете сохранить ключ сообщения, используя тот же механизм.

Apache Kafka® Topic Explorer, Manager и инструмент автоматизации

Kafka Magic — это инструмент с графическим интерфейсом для работы с кластерами Apache Kafka. Он может находить и отображать сообщения, преобразовывать и перемещать сообщения между темами, просматривать и обновлять схемы, управлять темами и автоматизировать сложные задачи.

Kafka Magic упрощает управление темами, контроль качества и интеграционное тестирование с помощью удобного пользовательского интерфейса.

Kafka Magic Community Edition БЕСПЛАТНО для личного и коммерческого использования. Загрузите Magic здесь!

Поиск, просмотр, фильтрация сообщений с помощью запросов JavaScript

- Просматривайте кластеры, темы и разделы Kafka.

- Поиск сообщений с помощью запроса JavaScript с любой комбинацией полей сообщений, заголовков, ключей.

- Фильтровать сообщения по разделу, смещению и отметке времени.

- Просмотр строковых, JSON или сериализованных сообщений Avro.

Публикация сообщений

- Публикация сообщений JSON или Avro в теме.

- Публикация сообщений с контекстом: ключ, заголовки, идентификатор раздела

- Опубликовать несколько сообщений в виде массива за один шаг

Перемещение сообщений между темами

- Найти сообщения в одной теме и отправить их в другую

- Преобразование сообщений и изменение назначенной схемы на лету

- Условное распределение сообщений между несколькими темами

Управление темами и схемами Avro

- Чтение метаданных кластера и темы

- Создание, клонирование и удаление тем

- Чтение и регистрация схем Avro

Автоматизация сложных задач

- Используйте JavaScript (полное соответствие ECMAScript) для написания скриптов автоматизации любой сложности.

- Создавайте сценарии из простых команд, поддерживаемых IntelliSense и помощниками автозаполнения

- Выполняйте длительные интеграционные тесты прямо из пользовательского интерфейса.

- Полный контроль над выполнением тестов

Kafka Magic эффективно работает с очень большими темами, содержащими миллионы сообщений.

Как вы можете читать с определенного смещения и раздела темы Kafka?

Пример использования:

Вы подтверждаете поступление записей и хотите читать с определенного смещения в тематическом разделе. В этом руководстве вы узнаете, как использовать потребителя консоли Kafka для быстрой отладки проблем путем чтения с определенного смещения, а также управления количеством читаемых записей.

Практический пример кода:

Короткий ответ

Если ваша тема Kafka находится в Confluent Cloud, используйте команду kafka-console-consumer с флагами —partition и —offset для чтения из определенного раздела и смещения.

Вы также можете читать сообщения из указанного раздела и смещать их с помощью Confluent Cloud Console:

Видеопрохождение

Запустить

Подготовьте свой кластер Kafka

Для этого руководства требуется доступ к кластеру Apache Kafka, а самый быстрый способ начать работу бесплатно — это Confluent Cloud, который предоставляет Kafka как полностью управляемый сервис.

После того, как вы войдете в Confluent Cloud, нажмите «Добавить облачную среду» и назовите среду «learn-kafka». Использование новой среды позволяет отделить ваши учебные ресурсы от других ресурсов Confluent Cloud.

В разделе «Счета и платежи» в меню примените промокод CC100KTS, чтобы получить дополнительные 100 долларов США бесплатного использования Confluent Cloud (подробности).

Нажмите LEARN и следуйте инструкциям, чтобы запустить кластер Kafka и включить реестр схем.

Инициализировать проект

Создайте локальный каталог для этого проекта в любом месте:

Далее создайте каталог для данных конфигурации:

Записать информацию о кластере в локальный файл

В Confluent Cloud Console перейдите к своему кластеру Kafka. В представлении «Клиенты» получите информацию о подключении, настроенную для вашего кластера (выберите Java ).

Создайте новые учетные данные для кластера Kafka и реестра схем, а затем Confluent Cloud покажет конфигурацию, подобную приведенной ниже, с автоматически заполненными новыми учетными данными (убедитесь, что установлен флажок «Показывать ключи API»). Скопируйте и вставьте его в файл configuration/ccloud.properties на своем компьютере.

| Не копируйте и не вставляйте указанную выше конфигурацию напрямую. Вы должны скопировать его из консоли Confluent Cloud, чтобы он содержал вашу информацию и учетные данные Confluent Cloud. |

Загрузите и настройте Confluent CLI

В этом руководстве есть несколько шагов по управлению темами Kafka и/или чтению или записи в темы Kafka, для которых вы можете использовать Confluent Cloud Console или установить Confluent CLI. Инструкции по установке Confluent CLI и его настройке для вашей среды Confluent Cloud доступны в Confluent Cloud Console: перейдите в свой кластер Kafka, щелкните ссылку CLI и инструменты и выполните шаги на вкладке Confluent CLI.

Создать тему с несколькими разделами

Ваш первый шаг – создать тему для производства и использования. На этот раз вы добавите несколько разделов, чтобы увидеть, как ключи попадают в разные разделы.

Используйте Confluent CLI для создания темы:

Создавать записи с ключами и значениями

Для начала давайте создадим несколько записей для вашей новой темы.

Поскольку вы создали тему с несколькими разделами, вы будете отправлять полные пары «ключ-значение», чтобы увидеть, как разные ключи оказываются в разных разделах. Чтобы отправить полные пары «ключ-значение», укажите параметры parse.key и key.separator в команде производителя консоли.

Давайте запустим следующую команду в контейнере брокера, чтобы запустить нового производителя консоли:

Затем введите эти записи либо по одной, либо скопируйте и вставьте их все в терминал и нажмите Enter:

После отправки записей вы можете закрыть производителя с помощью команды CTRL+C.

Запустите потребителя консоли для чтения из первого раздела

Далее давайте откроем потребителя консоли для чтения записей, отправленных в тему на предыдущем шаге, но вы будете читать только из первого раздела. Разделы Kafka отсчитываются от нуля, поэтому ваши два раздела пронумерованы 0 и 1 соответственно.

В Confluent CLI в настоящее время нет возможности указывать чтение из определенного раздела, поэтому для следующих нескольких шагов вы будете использовать потребителя консоли, встроенного в образ Docker. Обратите внимание, что вы передаете путь к созданному ранее файлу configuration/ccloud.properties.

Давайте запустим потребителя консоли для чтения только записей из первого раздела, 0

Через несколько секунд вы должны увидеть что-то вроде этого (ваш вывод будет зависеть от алгоритма хеширования):

Вы заметите, что отправили 12 записей, но только 6 попали в первый раздел. Причина этого в том, как Kafka вычисляет назначение раздела для данной записи. Kafka вычисляет раздел, взяв хэш ключа по модулю количества разделов. Таким образом, даже если у вас есть 2 раздела, в зависимости от хэш-значения ключа вам не гарантируется равномерное распределение записей по разделам.

Давайте выключим текущего потребителя с помощью CTRL+C

Запустите потребителя консоли для чтения из второго раздела

На предыдущем шаге вы использовали записи из первого раздела вашей темы. На этом шаге вы будете использовать остальные записи из второго раздела 1 .

Если вы еще этого не сделали, закройте предыдущий потребитель консоли с помощью CTRL+C .

Затем запустите новый потребитель консоли для чтения только записей из второго раздела:

Через несколько секунд вы должны увидеть что-то подобное

Как и следовало ожидать, оставшиеся 6 записей находятся во втором разделе.

Давайте выключим текущего потребителя с помощью CTRL+C

Читать записи, начиная с определенного смещения

До сих пор вы узнали, как использовать записи из определенного раздела. Когда вы указываете раздел, вы можете дополнительно указать смещение для начала потребления. Указание определенного смещения может быть полезно при отладке проблемы, поскольку вы можете пропустить использование записей, которые, как вы знаете, не являются потенциальной проблемой.

Если вы еще этого не сделали, закройте предыдущий потребитель консоли с помощью CTRL+C .

Из предыдущего шага вы знаете, что во втором разделе есть 6 записей. На этом шаге вы будете потреблять только записи, начиная со смещения 3, поэтому вы должны видеть только последние 3 записи на экране. Изменения в этой команде включают удаление свойства —from-beginning и добавление флага —offset

Вот команда для чтения записей из второго раздела, начиная со смещения 6:

Через несколько секунд вы должны увидеть что-то подобное

Как видите, вы израсходовали записи, начиная со смещения 3 и заканчивая концом журнала.

Давайте выключим текущего потребителя с помощью CTRL+C

Apache, Apache Kafka, Kafka и логотип Kafka являются товарными знаками Apache Software Foundation. Apache Software Foundation не имеет никакого отношения к этим материалам и не поддерживает их.

Авторское право © Confluent, Inc., 2014–2021 гг. Apache, Apache Kafka, Kafka и связанные названия проектов с открытым исходным кодом являются товарными знаками Apache Software Foundation